В М.Видео прошли путь от массовых офферов к персональным офферам с учётом маржинальности товаров. ROI маркетинговых акций вырос втрое. Кейс о том, как пошагово внедрить data-driven подход к персонализации офферов.

RFM-анализ, ML-алгоритмы и учет маржинальности: как в М.Видео втрое увеличили ROI акций

Задача

Увеличить окупаемость промоакций

Решение

Внедрить RFM-сегментацию и персонализировать промоИспользовать ML-модель для оценки склонности к покупкеПерсонализировать офферы по категории товара и ценовому сегменту

ИТ.

Сайт и мобильное приложение собственной разработки, feature store Customer360 (хранилище признаков для ML-модели), платформа SAP CRM, платформа автоматизации маркетинга Mindbox

Результат

80 → 248% ROI промоакций1,5 млрд ₽/мес инкрементальный GMV

Срок.

1,5 года

7 апреля 2026

Когда в базе 85 млн клиентов, каждая массовая акция дает моментальный прирост выручки. Но в М.Видео подсчитали, что это не окупается. ROI составлял всего 80% — компания получала 80 копеек с каждого вложенного рубля.

Чтобы это исправить, персонализировали акции. Сначала внедрили RFM-сегментацию: офферы стали зависеть от частоты, давности и суммы покупок. Затем подключили ML-модель: офферы стали получать только те клиенты, которые без скидки не купили бы. Финально дообучили ML-модель, и она стала подстраивать размер оффера под маржинальность товара, который клиент скорее всего купит.

Результат: ROI вырос втрое — до 248%. Кейс о том, как пошагово внедрить data-driven подход к персонализации офферов.

Содержание:

Результаты

-

80 → 248%ROI акций

-

5 →10%доля CRM-канала в общей выручке

-

2,9 →15%конверсия акции в покупку

-

Данные М.Видео, результаты за 1,5 года по AB-тестам с контрольной группой

-

1,5 млрд ₽ в месяцинкрементальный прирост товарооборота (GMV)

Данные М.Видео, результаты за 1 год работы ML-модели по AB-тестам с контрольной группой

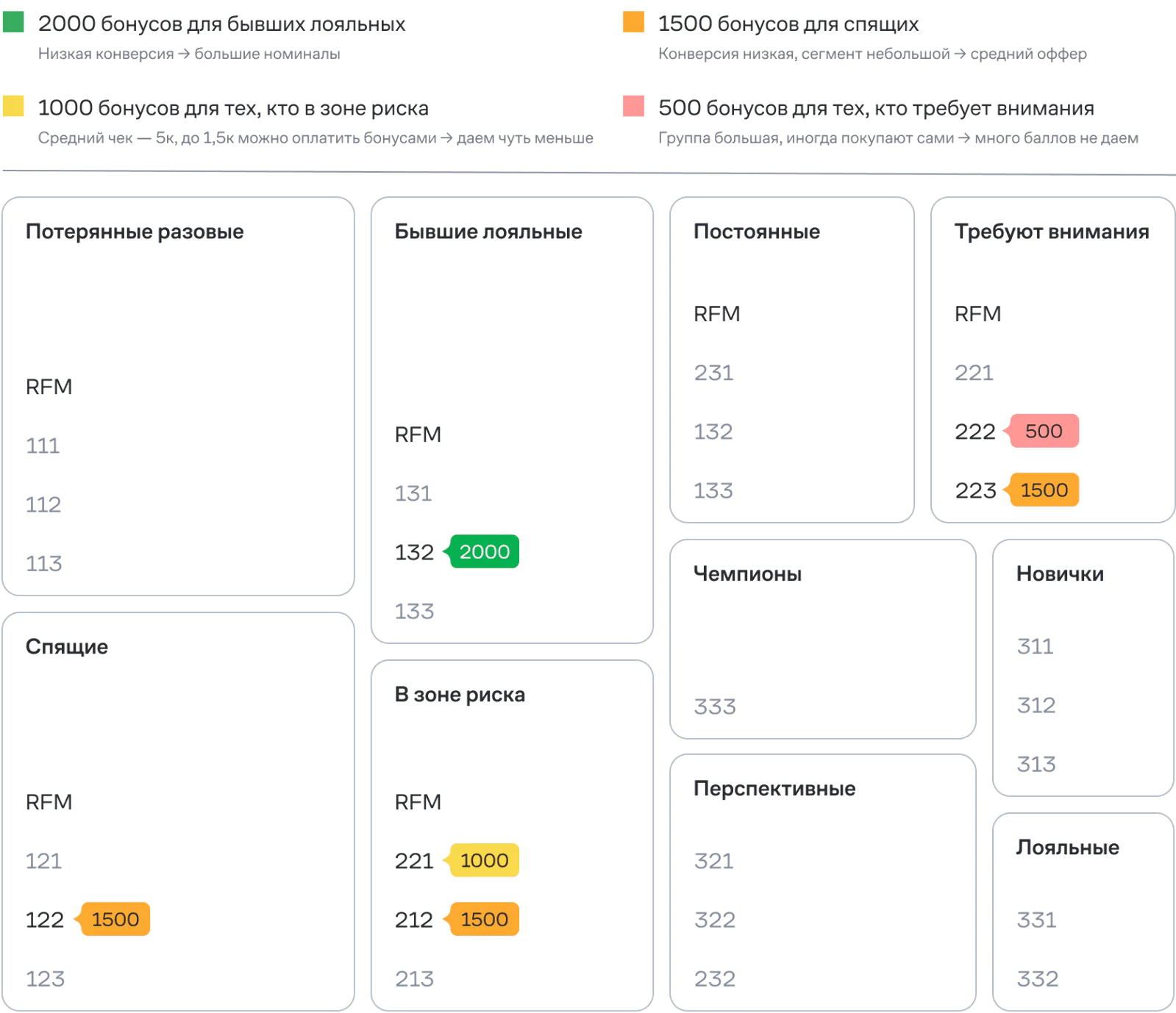

Эффективность акций в зависимости от уровня персонализации

Подход

Охват клиентской базы

Конверсия в применение оффера

ROI

Один оффер всей базе

79,5 млн

2,9%

80%

Офферы по RFM

30 млн

5,4%

124%

ML-модель

12,5 млн

11%

208%

Офферы с учетом маржинальности товаров

15 млн

15%

248%

Каждый вид промо решает свою задачу:

Один оффер всей базе — чтобы привлечь трафик в магазины.

Офферы по RFM-сегментации — чтобы распределять бюджет на промо в зависимости от давности, частоты и суммы покупки.

Офферы по ML-модели — чтобы находить клиентов, которых скидка подтолкнет к покупке, и не тратить бюджет на тех, кто и так купит.

Офферы с учетом маржинальности товара — чтобы сохранять прибыль.

Один оффер всей базе: почему массовые промо не окупались

М.Видео начинали с массовых промоакций: например, начисляли 1000 бонусных рублей всем клиентам. Это хороший оффер для ТВ, радио и наружной рекламы: можно запустить масштабную кампанию и привлечь новую аудиторию.

Но ROI таких акций составлял всего 80%, поэтому проводить их часто — невыгодно. Нужно было повысить эффективность регулярных акций, которые работают на возврат имеющихся клиентов, а не привлечение новых. Для этого сделали ставку на персонализацию.

Один оффер всей базе

Плюсы

Минусы

Растет трафик онлайн и в магазинах. В среднем на 20% по каждой акции

Активирует бонус-хантеров. Некоторые клиенты охотятся за скидками: регистрируют несколько аккаунтов, чтобы получить больше скидок, и редко покупают по полной цене

Охватывает всех. Можно дотянуться до максимального числа клиентов за одну коммуникацию. Не нужно тратить время на сегментацию и настройку разных механик

Сложно выделить контрольную группу. Когда оффер транслируется по радио, ТВ или в наружной рекламе, непонятно, кто из клиентов купил бы и без него

«Спящие» клиенты возвращаются, приходят новые

Низкая окупаемость акций. ROI ~80%, конверсия в применение оффера — 2,9%

Промо по RFM-сегментам: офферы в зависимости отдавности, частоты и суммы покупок

-

80 → 124%ROI

-

2,9 → 5,4%конверсия в применение оффера

Сравниваются показатели массовых промо и по RFM-сегментам

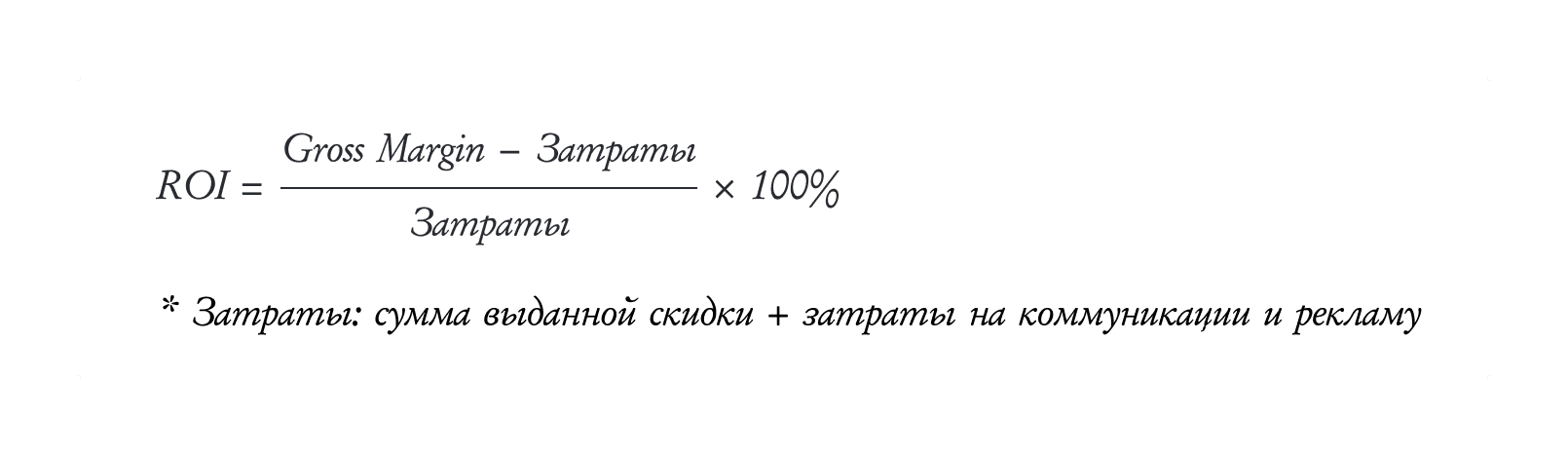

Сначала выяснили, какие клиенты приносят больше прибыли и охотнее откликаются на офферы. Для этого провели RFM-анализ и разделили базу на 9 сегментов по давности, частоте и сумме покупок. Это позволило назначать офферы разного размера. Например, в сегменте «требуют внимания» есть клиенты, которые покупают обычно на большие суммы. Их важно вернуть, а большой оффер не снизит маржинальность заказа — поэтому им дают 1500 бонусов. А для «требующих внимания», которые не покупали на большие суммы, можно начислить меньше баллов — 500. Так скидка не «съест» слишком большую долю маржи.

Код сегмента — три цифры: давность последней покупки, частота, сумма. Чем выше цифра — тем покупка свежее, чаще и на большую сумму

Мы разработали свою гибкую RFM-сегментацию, чтобы пересматривать границы сегментов, когда растет средний чек и меняется внешняя среда. На расчет и тестирование у нас ушло 2–3 месяца.

В 2024 году запустили офферы по RFM-сегментам. Охват акций сократился с 79,5 млн до 30 млн человек — неприоритетным сегментам перестали давать офферы. Каждая акция стала дешевле, поэтому на тот же бюджет мы стали запускать несколько промо в месяц — и каждое окупается. При этом массовые промо все равно сохранили: используем их для крупных инфоповодов и чтобы расширить базу клиентов.

ML-модель склонности к покупке: оффер только тем, кому он нужен

RFM берет в расчет только историю покупок и не учитывает поведение клиента в реальном времени. Появилась гипотеза, что офферы могут получать клиенты, которые сделали бы покупку и без скидки. Чтобы это проверить, разработали ML-модель.

Как проверили, насколько эффективно работают офферы по сегментам

ML-модель оценивает вероятность покупки на основе поведения клиента. У каждого свой паттерн: кто-то начинает чаще заходить на сайт, кто-то проводит больше времени на страницах, добавляет товары в избранное и сравнивает их. Модель анализирует историю пользователя и выявляет такие паттерны — они сигнализируют, что клиент близок к покупке.

ML-модели «скормили» действия клиентов за предыдущие года и попросили определить вероятность покупки. По результатам клиентов разделили на 20 сегментов: от «скорее всего не купит» до «скорее всего купит».

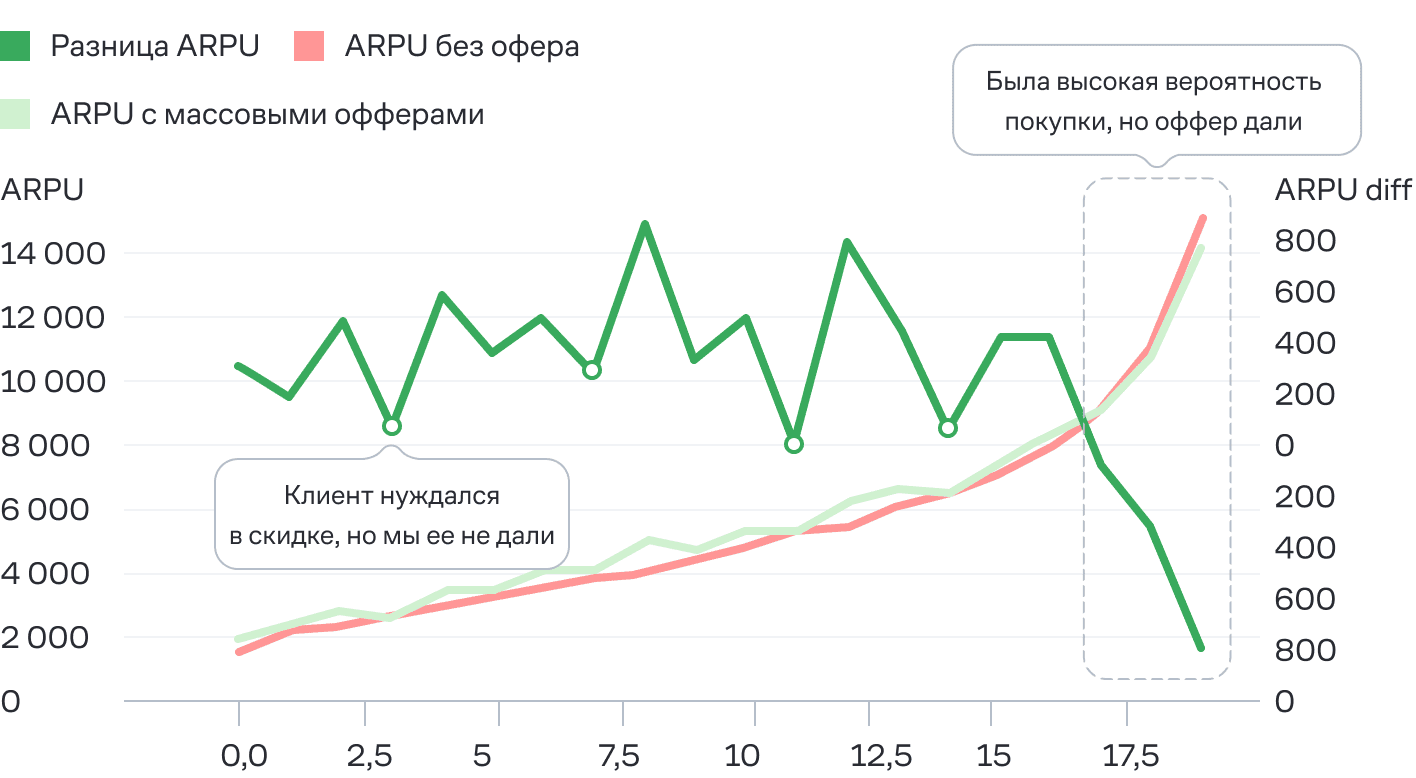

Так как офферы по RFM начислялись не всем сегментам, часть клиентов в выборке не получала их. Их ARPU сравнили с ARPU клиентов, которые получили этот оффер. Для чистоты сравнивали показатели сегментов с одинаковой вероятностью покупки.

Выяснили, что у клиентов с высокой вероятностью покупки ARPU клиентов с оффером ниже, чем без оффера. Это значит, что оффер выдали клиентам, которые купили бы и без него.

Также периодически ARPU клиентов с офферами значительно превышал ARPU клиентов без оффера. Это значит, что в такие моменты дополнительный оффер в этот момент мог бы склонить клиента к покупке, но компания его не дала.

Сравнили ARPU клиентов с офферами и без. Слева — клиенты с низкой вероятностью покупки, справа — с высокой. Если разницы нет — оффер дали зря: клиент и так бы купил

Как работает ML-модель склонности к покупке

Чтобы добиться более глубокой персонализации офферов, ML-модель дообучили. Она начала распознавать клиентов, которые скоро совершат покупку — их исключают из промо, так как скорее всего они купят и без оффера. Также ML-модель находит клиентов, которые не готовы к покупке прямо сейчас, но купят вместе с оффером — таким начисляют бонусы, чтобы подтолкнуть к покупке.

Кроме склонности к покупке, есть и дополнительные фильтры, которые учитывает модель. Они защищают бизнес от потери денег из-за фрода и лишних начислений:

Фильтр 1: антифрод. Бонус-хантеры регистрируют несколько аккаунтов, чтобы получить офферы на каждый из них. Такие аккаунты выдает странная почта, нетипичные паттерны кликов. Если есть признаки мошенничества, клиент попадает в карантин. Ему не начисляют офферы пока он не начнет вести себя естественно: заходить на сайт, смотреть товары, совершать покупки.

Фильтр 2: активные офферы. Если у клиента уже есть скидка, новую не начисляют. Иначе снижается маржинальность, а клиент и так уже получил стимул к покупке.

Фильтр 3: новички. После регистрации у пользователей наступает «инкубационный период» около месяца. Модель копит данные: смотрит на поведение, проверяет историю покупок. Это помогает ей работать эффективнее, а также защищает от бонус-хантеров. Вместо персональных акций для новичков проводят массовое промо. Например, дают бонусы за установку мобильного приложения.

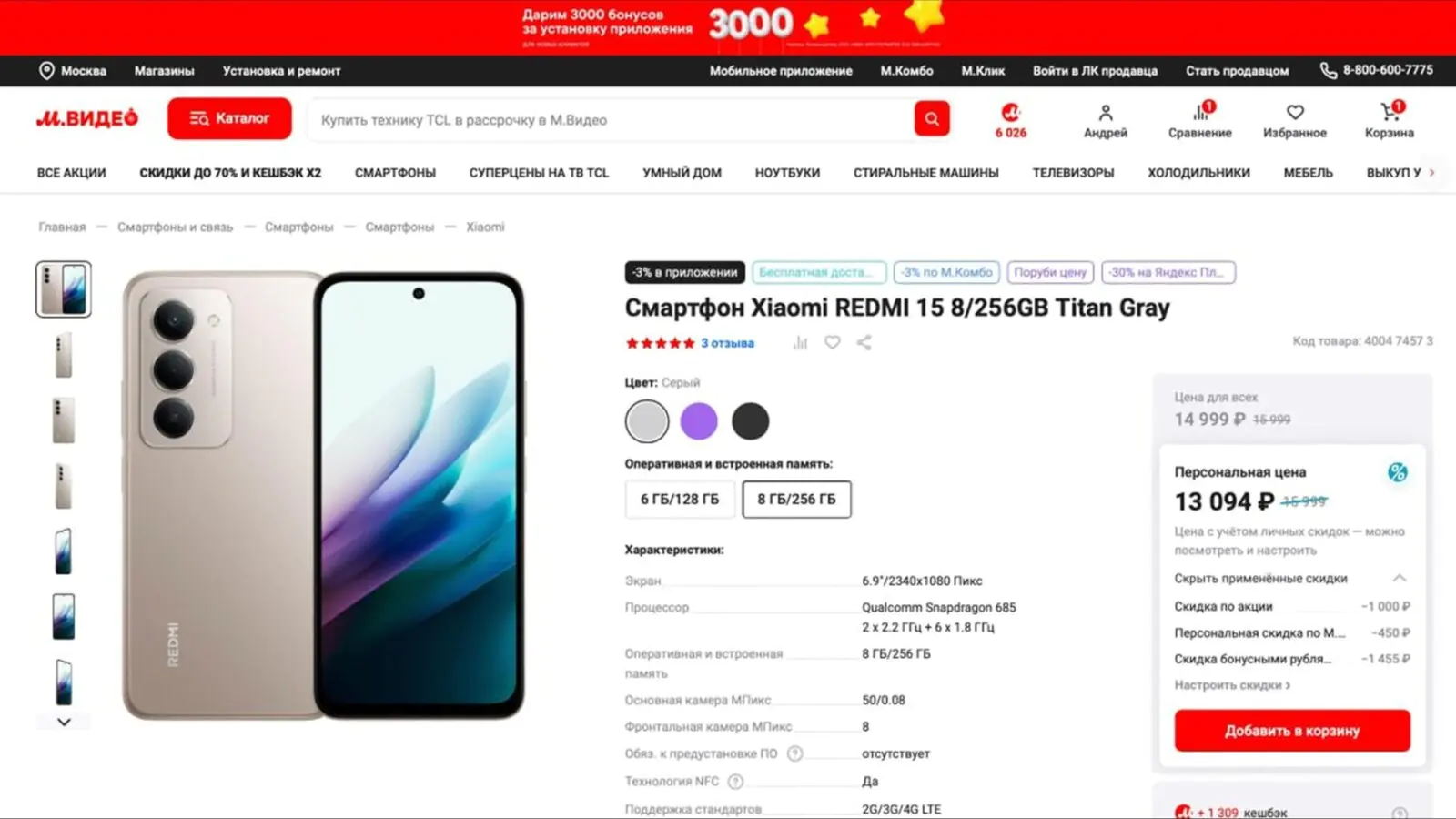

Цены на сайте отображаются уже с учетом персональной скидки. Это позволяет работать даже с теми клиентами, которые не дали согласия на маркетинговые рассылки. Целевой клиент «горячий»: он активно выбирает товар, регулярно заходит на сайт и сам видит, что цена изменилась — это стимулирует его к покупке.

На карточке товара клиент видит итоговую стоимость с учетом скидки

Как протестировали результат от ML-модели

Запускать офферы от ML-модели сразу на всю базу было рискованно, поэтому начали с AB-теста.

Гипотеза: ML-модель находит клиентов, которых оффер подтолкнет к покупке. Если модель работает, тестовая группа купит больше, чем контрольная.

Сегмент: весь входящий онлайн-трафик, кроме клиентов, у которых уже есть активный оффер.

Весь трафик делили на сегменты «одинаковой температуры»: новые, повторные, в оттоке, реактивированные. А каждый сегмент — пополам на тестовую и контрольную группу.

Механика: ML-модель анализировала поведение клиентов из тестовой группы. Тем, кому оффер необходим, выдавала 1500 бонусных рублей. В контрольной группе никто из клиентов офферы не получал.

Метрика: инкрементальная конверсия в покупку.

Сегмент

Прирост конверсии в покупку

Повторный

+3,9 п. п.

Отток

+2,6 п. п.

Реактивированный

+3,1 п. п.

Новый

+2,8 п. п.

Тест показал: все сегменты тестовой группы стабильно обгоняли контрольную по конверсии в покупку. Наибольший инкремент дали повторные клиенты — те, кто уже покупал раньше.

Несмотря на тест, ML-модель не масштабировали сразу на всю базу. Опасались, что мошенники научатся взламывать алгоритм. Поэтому 20% базы оставили в контрольной группе, чтобы продолжать измерять инкрементальный эффект.

Гибкие скидки, которые зависят от маржинальности товара

-

1,5 млрд ₽ в месяцинкрементальная выручка после полной раскатки ML-модели на всю базу (без учета постоянной контрольной группы)

-

+4 п. п.прирост конверсии офферов ML-модели в покупку — за счет учета маржинальности товаров

Прошлая версия ML-модели давала всем одинаковую скидку — 1500 бонусных рублей. Это самый популярный оффер компании, он составляет примерно 10% от среднего чека. Но для чехла за 5000 ₽ скидка 1500 ₽ — это 30%, очень щедрое предложение. А для стиральной машины Miele за 300 000 ₽ скидка 1500 ₽ — это 0,5%, слишком мало, чтобы подтолкнуть к покупке.

Команда научила ML-модель решать не только кому дать оффер, но и какой. Теперь алгоритм определяет товар, который клиент скорее всего купит. И в зависимости от его стоимости и маржинальности определяет, какую скидку выдать. Для недорогих аксессуаров скидка 500 ₽, для премиальной техники — до 5000–7000 ₽.

Каждый день на сайт и в приложение заходят 390 тыс. уникальных клиентов. Из них модель отбирает тех, кому оффер поможет решиться на покупку — это примерно 11% трафика, или 43 тыс. человек в день.

За год модель привела 494 тыс. клиентов к покупке. ROI промоакций вырос до 248%. Это — хороший результат, но не финальная точка. Внутренний ориентир команды — 300%: один затраченный рубль должен приносить три.

Бонус: на каких данных работает ML-модель склонности к покупке

Для работы ML-модели в М.Видео создали Customer360 — собственное хранилище признаков, по которым ML-модель оценивает клиента. Например:

Профиль клиента — статус участия в программе лояльности, сегмент, любимый магазин. Добавления в корзину, просмотры карточки товара, покупки, чекауты, поиски, фильтры, клики по рекламе, давность последнего заказа, количество дней между покупками, количество уникальных SKU в заказах.

Финансы — давность последней рассрочки или займа, персональный кредитный лимит.

Промо — сумма, процент и средний размер скидки, изначальная цена товара, объем списаний, начислений, сгораний баллов, дата последнего списания, среднее количество дней от начисления до списания.

Данные в Customer360 обновляются с разной частотой в зависимости от их типа:

Статические данные (номер телефона, ФИО, пол, возраст) записываются обычно при регистрации или когда клиент звонит в колл-центр.

Расчетные метрики (средний чек, частота покупок) пересчитываются раз в сутки.

Поведенческие метрики с сайта и приложения (заходы, время на карточке товара, добавления в избранное) обновляются мгновенно. Клиент добавил товар в избранное — модель уже это видит.

Планы

Внедрить ML-модель в офлайне. В магазинах есть мобильное приложение для консультантов. Компания планирует интегрировать его с ML-моделью, чтобы консультант видел рекомендацию модели: кому предложить скидку и какого размера.

Протестировать другие типы офферов. Сейчас модель работает только с бонусными рублями. Компания тестирует другие варианты: персональную прямую скидку без бонусов, бесплатную доставку, бесплатную установку техники. Это поможет еще больше снизить давление на маржинальность.

Построить OfferHub — систему из 5–6 офферов для каждого клиента, где каждый влияет на свою метрику: один — на маржу, другой — на GMV, третий — на частоту покупок. В моменте клиент видит один оффер. Бизнес сможет приоритизировать офферы в зависимости от текущих целей.

P. S. В этой истории мы рассказывали о нашем продукте CDP. Узнайте подробнее на его странице или в разговоре с консультантом.