Правила использования нейросетей в России пока формируются. При этом маркетологи уже создают креативы, персонализируют коммуникации и прогнозируют поведение клиентов с помощью ИИ. Вместе с лидом юридической команды Mindbox Кирой Лукашиной разобрались, как безопасно работать с нейросетями, чтобы не получить штраф или иск.

20 мая 2025

Законы в области искусственного интеллекта: какие действуют в России и что учесть маркетологам

Искусственный интеллект помогает автоматизировать процессы, анализировать и предсказывать поведение пользователей, придумывать идеи для креативов. Но четких правил использования ИИ в маркетинге в России нет. Из-за этого не всегда понятно, кому принадлежит контент, кто несет за него ответственность и как защитить права авторов.

Вместе с лидом юридической команды Mindbox Кирой Лукашиной разбираем, как безопасно использовать искусственный интеллект в проектах.

Какие законы об ИИ работают в России

В России пока нет единого закона об искусственном интеллекте. Вместо этого есть несколько документов, которые регулируют использование технологии в разных сферах, в том числе медицине, строительстве, промышленности, финансах, государственных услугах и разработке беспилотного оборудования. В основном это рекомендации. Но законодательство в области ИИ развивается, и на основе этих документов могут разработать конкретные требования, которые нужно будет соблюдать.

Национальная стратегия ИИ

Статус: утверждена в 2019 году

Задает вектор развития ИИ в России до 2030 года. Стратегия — это не закон в буквальном смысле, но она влияет на развитие экономики, науки и общества, на ее основе инициируются и принимаются новые законы. Государство инвестирует в ИИ для образования, промышленности и госсектора. Компании получают приоритет в грантах и право участия в госпрограммах, если развивают ИИ в целевых направлениях.

Закон об экспериментальных правовых режимах (ЭПР)

Статус: принят и действует с 2020 года

С экспериментальным режимом тестировать продукты с ИИ проще и безопаснее: ЭПР смягчает законодательство, а разработчики используют ограниченную и контролируемую среду. При этом участники эксперимента все равно несут ответственность, если разработка стала угрозой для жизни и безопасности человека.

Стандарты в области ИИ

Статус: к марту 2025 года разработано 152 стандарта

Стандарты — не законы, но на эти правила будут опираться те, кто разрабатывает и применяет искусственный интеллект. Они описывают, как должен работать ИИ, как его тестировать, проверять его надежность и безопасность.

Уже появились конкретные стандарты: ГОСТ с принципами, стандарты для систем измерений на основе ИИ — их будут применять, например, на заводах или в научных лабораториях. Есть стандарты для наборов данных и моделей машинного обучения, которые измеряют свойства материалов без прямого контакта — это нужно в производстве полимеров и 3D-печати.

Уже появились конкретные стандарты: ГОСТ с принципами, стандарты для систем измерений на основе ИИ — их будут применять, например, на заводах или в научных лабораториях. Есть стандарты для наборов данных и моделей машинного обучения, которые измеряют свойства материалов без прямого контакта — это нужно в производстве полимеров и 3D-печати.

На момент подготовки этого материала в Госдуме планировали разработать федеральный закон «О регулировании систем искусственного интеллекта». Эксперты опасаются, что если правила для разработчиков ИИ напишут без понимания, как работает технология, компании столкнутся с излишним контролем и неопределенностью. Это может замедлить запуск продуктов, увеличить юридические риски и затруднить работу на рынке. Особенно это касается стартапов и ИТ-компаний: им будет сложно предугадать, какие требования к ИИ будут считаться обязательными, и как суды будут трактовать спорные ситуации.

Кодекс этики ИИ

Статус: принят в 2021 году, добровольное соблюдение

Описывает, как использовать ИИ ответственно — без дискриминации, с раскрытием информации, без подмены человека. Представим онлайн-сервис, который использует ИИ, чтобы советовать пользователю лечение по симптомам — что-то вроде чат-бота «домашнего врача».

Если разработчики не проверили работу алгоритма, и сервис советует неправильное лечение или лекарства в конкретных дозировках, это может нанести вред здоровью человека. Даже если у создателей не было злого умысла, такой сервис нарушает принцип непричинения вреда. Компания обязана заранее протестировать ИИ, привлечь врачей и обеспечить точность рекомендаций. Если этого не сделано — использовать такой ИИ этически недопустимо.

Закон о рекомендательных технологиях

Статус: принят и действует с 2023 года

Рекомендательные технологии — алгоритмы, которые подстраивают контент под интересы пользователя. Закон нужен, чтобы сделать использование таких технологий прозрачным и защитить права пользователей. Теперь владельцы сайтов и приложений обязаны:

Рекомендательные технологии — алгоритмы, которые подстраивают контент под интересы пользователя. Закон нужен, чтобы сделать использование таких технологий прозрачным и защитить права пользователей. Теперь владельцы сайтов и приложений обязаны:

- Сообщать пользователям, что такие алгоритмы используются.

- Публиковать правила работы этих технологий простым языком.

- Указывать контактную информацию компании.

Если эти требования не выполнить, сервис могут заблокировать.

Риски для маркетологов, которые используют ИИ

Нарушение авторских прав. Нейросети обучаются на базах данных, которые могут включать защищенные авторским правом изображения, тексты художественных книг или музыку. В некоторых странах, например в США, использование произведений для обучения нейросетей может подпадать под концепцию добросовестного использования (fair use), если оно ограничено и не наносит существенного ущерба владельцу авторских прав. Однако в большинстве стран, включая РФ, это право четко не прописано.

Громких судебных разбирательств из-за нарушения авторского права нейросетями в мире пока немного:

- Первый коллективный иск за пределами России подали американские художники против создателей ИИ-генераторов Midjourney и Stability AI. Они утверждают, что их работы использовали для обучения нейросетей без разрешения. Суд согласился, что претензии обоснованы, и разрешил изучить, какие данные использовали разработчики. Например, модель Stable Diffusion обучали на базе из миллиардов картинок, собранных в интернете, и эти изображения могли быть защищены авторским правом. Теперь разработчиков обвиняют в незаконном использовании чужих произведений. В конце 2024 года процесс был еще на стадии рассмотрения.

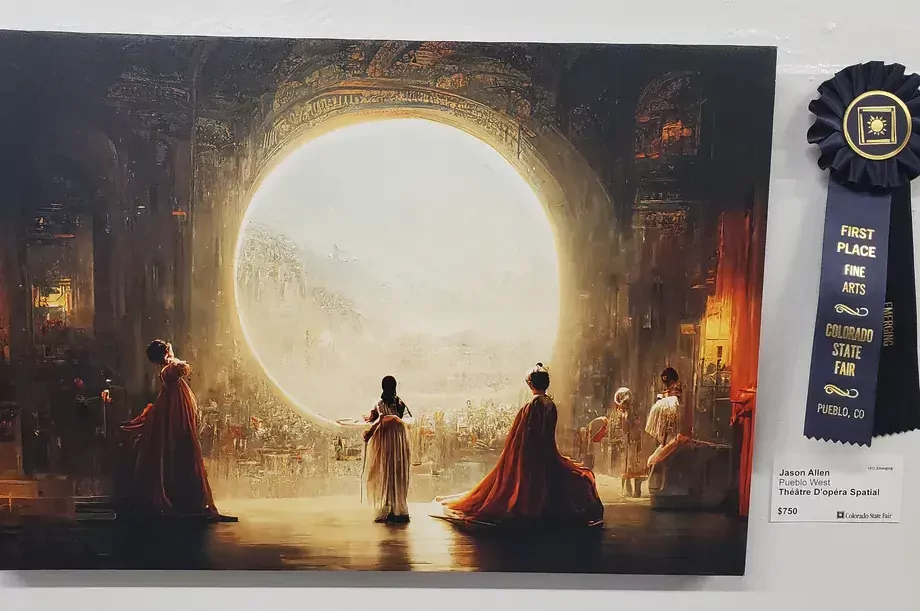

- Джейсон Аллен создал в MidJourney изображение, выиграл в художественном конкурсе в Колорадо, но не смог зарегистрировать авторские права на произведение. Бюро авторского права США отказало ему из-за отсутствия «человеческого авторства»: даже если для создания изображения использовали сотни промптов, это не считается человеческим вкладом.

После отказа в регистрации авторских прав на иллюстрацию Théâtre D’opéra Spatial работу Аллена стали массово копировать — без разрешения выставлять на продажу на Amazon, Etsy и платформе для продажи NFT OpenSea. Аллен уверен, что это связано с враждебной реакцией традиционных художников.

Чтобы создать генерацию, дизайнер написал 624 промпта

- В Москве суд обязал компанию Roistat выплатить 500 тысяч рублей за использование дипфейк-ролика с лицом Киану Ривза без согласия правообладателя.

Видео создали Agenda Media Group и передали партнерам «Рефейс Технолоджис». Эта компания создает и размещает в интернете юмористические ролики с голливудскими звездами. Roistat незаконно применил ролик в своей рекламе и заявил, что нейросетевой контент не регулируется авторским правом. Суд постановил, что дипфейк — лишь инструмент обработки, а произведение защищено, поскольку создано с участием людей.

- Дело диктора Алены Андроновой против «Т-Банка». В 2019 году Алена записала голосовые фразы для систем автоответа «Т-Банка». Позже она узнала, что банк использует синтез ее голоса. Она подала в суд, требуя удалить синтез, запретить его использование и выплатить 5,96 млн рублей. В ответ «Т-Банк» заявил, что договор предусматривал передачу исключительных прав на записи, включая право на переработку и использование третьими лицами. Суд в иске отказал, посчитав действия банка законными. Дело еще не закрыто — идет апелляция.

Нарушение права человека на использование его образа. Если изображение человека используется без его согласия, это может привести к судебным искам за нарушение права на образ. Например, для рекламного баннера сгенерировали изображение лица на основе публичных фотографий человека. Если он не давал согласия использовать свой образ, баннер может стать причиной разбирательств.

Как безопасно использовать нейросети в маркетинге

Проверять пользовательские соглашения платформ

У каждой модели искусственного интеллекта есть условия использования сервиса, в которых прописаны основные правила и ограничения, в том числе информация о том, кому принадлежат права на сгенерированный контент. Ограничения касаются и генераций на платформе, и использования функционала платформы в сторонних продуктах через API. Компании предупреждают в этих документах, что могут в любой момент изменить условия. Например, спустя некоторое время после предыдущего обновления документа запретить коммерческое использование генераций.

Разберем условия популярных моделей.

Нейросеть

Для чего используют

Условия использования генераций

Ссылка на соглашение

Midjourney

Генерация изображений

Платформа не ограничивает пользователей, но отмечает, что права на сгенерированное изображение определяет конкретная юрисдикция. Пока в России нет закона об ИИ, в теории нейрокартинку можно использовать в рекламе. Могут возникнуть споры об авторском праве, если нейросеть сгенерирует для разных пользователей похожие изображения

Dalle

Генерация изображений

Теперь Dalle — часть Open AI и не ограничивает использование сгенерированных изображений. Главное — не использовать контент во вред другим людям. Например, для травли и клеветы

«Кандинский»

Генерация изображений

Права на генерации принадлежат пользователю. Контент можно использовать в коммерческих целях, но в рамках законов РФ. Например, рекламный креатив с курящим героем нарушает Федеральный закон от 13.03.2006 № 38-ФЗ «О рекламе»

«Шедеврум»

Генерация изображений

Права на генерации принадлежат «Яндексу». Использовать в коммерческих целях возможно только с согласия «Яндекса»

Stable Diffusion

Генерация и редактирование изображений, генерация макетов интерфейсов и подписей к иллюстрациям

Компания ссылается на законы Великобритании и не несет ответственности за контент, который сгенерировал пользователь. Если генерация будет содержать клевету или запрещенный для рекламы контент, отвечать за нарушение придется ее автору. Чтобы не попасть в такую ситуацию, перед использованием платформы в коммерческих целях лучше проконсультироваться с юристом

Suno

Генерация музыки

Платформа запрещает использовать генерации в коммерческих целях и предупреждает, что ответственность за использование нейромузыки несет автор генерации

Проверять контент на уникальность. Например, уникальность текста или рекламного слогана можно проверить в сервисе «Антиплагиат», музыку — в Mippia. Однако ни один сервис не сможет провести полноценную экспертизу произведения. Чтобы обезопасить себя от возможных претензий со стороны авторов, можно привлекать внешних экспертов, которые специализируются на текстах, изображениях или музыке. Если экспертиза выявит плагиат, придется получить от правообладателя согласие на использование его творчества.

Получить согласие на использование изображений. Например, для рекламного баннера сгенерировали изображение персонажа, который напоминает известного актера. Безопаснее заменить образ героя на нейтральный, поскольку использование изображений реальных людей незаконно без их согласия.

Вероятность того, что голливудский актер подаст жалобу на креатив для новогодней акции со своим изображением, — низкая. Но безопаснее заменить персонажа на нейтрального. Сгенерировано в YandexART

Использовать сервисы по поиску плагиата. Например, поисковые системы копий вроде TinEye или PlagScan помогают найти, кто в интернете использует изображения или тексты.

Если компания оформила авторское право на сгенерированное произведение, а его украли, можно направить претензию нарушителю. Часто компании предпочитают досудебное урегулирование. Если договориться не получится, нужно обращаться в суд с доказательствами авторства. Например, если маркетинговый ролик компании скопирован конкурентом, можно потребовать удалить контент и компенсировать убытки.

Прописывать в договоре ответственность сторон. Если к проекту подключают внешних специалистов, нужно прописать, кому принадлежат права на контент после завершения проекта, кто несет ответственность за проверку и использование контента. Например, в договоре с агентством, которое пишет рекламные тексты и использует ИИ, нужно указать: агентство гарантирует, что не нарушит авторские права. Если компания столкнется с претензиями из-за использования ИИ-контента, договор должен предусматривать возможность взыскания компенсации с виновной стороны. Например, подрядчик сгенерировал изображение с нарушением авторских прав и по условиям договора компенсировал расходы заказчика на урегулирование спора.

Учитывать ограничения, связанные с обработкой персональных данных. Обучение ИИ-моделей, включая маркетинговые алгоритмы, часто основано на анализе больших объемов информации. Законодательство в России обязывает компании соблюдать ФЗ-152 «О персональных данных»: обрабатывать данные физических лиц нужно с учетом положений закона.

Какие законы регулируют искусственный интеллект?

В России прямых законов об ИИ пока нет. Работу с нейросетями регулируют существующие нормы: авторское право (статья 1259 ГК РФ), закон о персональных данных (152-ФЗ), закон о рекламе (38-ФЗ).

Законно ли использовать ИИ для заработка денег?

Да, использовать ИИ для заработка законно. Можно продавать товары или услуги, созданные с помощью нейросетей: тексты, изображения, дизайн, код. Главное ― соблюдать правила:

― Не нарушать чужие авторские права ― нельзя обучать нейросеть на чужих защищенных произведениях без разрешения или генерировать контент, который копирует чужие работы.

― Быть честным с клиентами ― нельзя продавать контент, сгенерированный ИИ, как созданный человеком. Лучше указывать, что использовался ИИ, или существенно дорабатывать результат.

― Соблюдать закон о рекламе ― рекламный контент, созданный ИИ, не должен вводить в заблуждение или нарушать этические нормы.

― Не использовать персональные данные ― нельзя обучать ИИ на данных людей без их согласия или генерировать контент с их изображениями без разрешени.

Проблема в том, что контент, полностью созданный ИИ без творческого вклада человека, не защищается авторским правом в России. Это значит, что другие могут использовать ваш сгенерированный контент без ограничений.

Можно ли использовать картинки ChatGPT в коммерческих целях?

Технически да, но с оговорками. По пользовательскому соглашению OpenAI (компании, которая создала ChatGPT), пользователь получает права на контент, сгенерированный ИИ, и может использовать его коммерчески. Но есть риски:

Отсутствие авторской защиты в России ― изображения, полностью созданные нейросетью без творческого вклада человека, не охраняются авторским правом. Это значит, что другие могут использовать ту же картинку без ограничений.

Возможные нарушения чужих прав ― если нейросеть сгенерировала изображение, похожее на чужую защищенную работу, правообладатель может предъявить претензии. ChatGPT обучался на огромных массивах данных, включая защищённые изображения.

Ответственность лежит на пользователе ― OpenAI в соглашении указывает, что пользователь сам отвечает за законность использования контента. Если возникнут претензии, разбираться придётся самостоятельно.

Безопаснее существенно дорабатывать изображения от ИИ, добавляя творческий вклад. Тогда можно претендовать на авторство доработанного варианта.